La nouveauté d’Anthropic menace et renforce la cybersécurité à la fois

Le nouveau modèle d’IA d’Anthropic, Mythos, serait si performant pour détecter et exploiter les failles de sécurité informatique qu’il ne sera pas rendu public. Révolution ou simple opération de communication ?

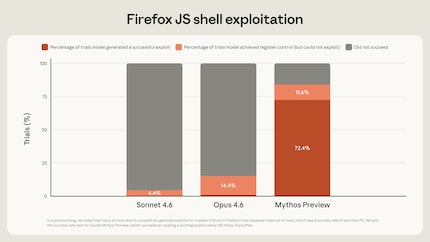

Anthropic a développé un nouveau modèle d’IA baptisé Claude Mythos Preview (en abrégé : Mythos). Il s’agit d’un grand modèle de langage (LLM) à usage général, mais qui excelle particulièrement dans la détection de failles de sécurité informatique, selon Anthropic. Mythos aurait déjà découvert des milliers de vulnérabilités graves et jusqu’alors inconnues, y compris dans tous les principaux systèmes d’exploitation et navigateurs Internet.

Selon Anthropic, Mythos est capable de repérer les failles de sécurité, et dans certains cas de les corriger. En revanche, l’outil programme aussi, sur demande, des exploits fonctionnels, c’est-à-dire du code qui exploite effectivement la vulnérabilité. Mythos a donc le potentiel d’améliorer considérablement la sécurité informatique, mais aussi de causer des dégâts immenses s’il tombait entre de mauvaises mains.

Source : Anthropic

Le modèle n’est pas accessible au grand public. Pour l’instant, Anthropic a lancé le Project Glasswing, dans le cadre duquel des acteurs sélectionnés obtiennent un accès pour résoudre les problèmes de sécurité.

Parmi eux figurent Apple, Google, Microsoft et la Linux Foundation, soit les développeurs des principaux systèmes d’exploitation et navigateurs web. On y trouve également Amazon Web Services, Anthropic, Broadcom, Cisco, Crowdstrike, JPMorgan Chase, NVIDIA et Palo Alto Networks. Ainsi que plus de 40 autres entreprises et organisations non citées.

Des exemples impressionnants

Mythos détecte aussi des failles de sécurité dans des logiciels réputés particulièrement sûrs et ayant été vérifiés d’innombrables fois. Anthropic cite en exemple un bug dans le système d’exploitation OpenBSD, resté apparemment indétecté pendant 27 ans. Une simple connexion à distance suffit pour faire planter la machine. OpenBSD est fréquemment utilisé pour les serveurs et les pare-feu en raison de son haut niveau de sécurité.

Un autre exemple concerne le logiciel vidéo FFmpeg. Un bug dans ce logiciel serait passé inaperçu pendant 16 ans malgré des millions d’analyses de sécurité automatisées. Un troisième exemple touche le noyau Linux. Selon Anthropic, une combinaison de plusieurs failles permet de prendre le contrôle total de l’ordinateur.

Ces vulnérabilités ayant depuis été corrigées, Anthropic a publié des détails techniques (en anglais) à ce sujet.

Des questions en suspens

Anthropic prévoit une entrée en bourse cet automne et a besoin de capitaux. Le rapport représente donc un signal adressé aux investisseurs potentiels pour montrer qu’Anthropic développe les outils les plus avancés. Les exemples présentés sont impressionnants, et l’affirmation selon laquelle Mythos serait particulièrement performant en matière de cybersécurité paraît globalement crédible.

Le fait que l’outil ne soit pas rendu public pour l’instant semble également être une sage décision. Un outil capable de révéler d’un seul coup des milliers de failles de sécurité graves ne doit en aucun cas tomber entre de mauvaises mains. Si les développeurs corrigent rapidement les vulnérabilités, cet outil pourrait même renforcer la sécurité.

Plusieurs questions restent cependant ouvertes sur ce point. D’une part, on peut se demander si le logiciel peut véritablement rester sous clé, et si Anthropic le souhaite vraiment, puisque Mythos a en fait été conçu comme une IA généraliste destinée à un large usage qui dépasse nettement le domaine de la cybersécurité. Même si Mythos n’est jamais publié, les modèles concurrents devraient atteindre un niveau comparable dans un avenir proche. Par ailleurs, il est envisageable que des services de renseignement disposent déjà de modèles d’IA aux capacités similaires. Quoi qu’il en soit, les développeurs ont tout intérêt à mettre les bouchées doubles pour corriger les failles.

Évidemment, on ignore si les vulnérabilités découvertes n’étaient inconnues que des développeurs ou de l’ensemble de l’humanité. De nombreuses failles zero-day sont gardées secrètes et revendues à prix d’or sur le marché noir, qui attire des criminels ainsi que des services de renseignement et la police (rappelez-vous les chevaux de Troie gouvernementaux). Si l’on part du principe que bon nombre de ces vulnérabilités sont déjà connues dans les milieux clandestins, peut-être même avec des exploits fonctionnels, cet outil d’IA devrait alors constituer une amélioration de la sécurité.

L’éventuelle interdiction

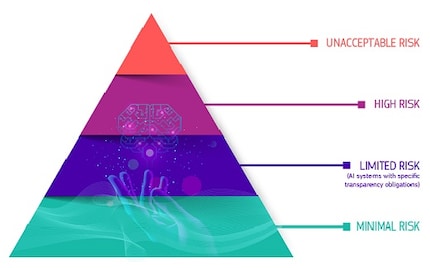

Se pose enfin la question d’une régulation étatique. Le règlement européen sur l’IA classe les applications d’IA en différents niveaux de risque. Les outils accessibles au grand public relèvent pour le moment du deuxième niveau le plus bas, celui du « risque limité » (limited risk), qui n’impose aucune contrainte supplémentaire hormis une obligation de transparence. Néanmoins, la situation pourrait être différente dans le cas présent. Je ne suis pas juriste, mais d’après ce que je comprends, une IA permettant d’attaquer des infrastructures critiques sans connaissances particulières relèverait du niveau « risque inacceptable », ce qui entraînerait une interdiction.

Source : digital-strategy.ec.europa.eu

Mon intéret pour l'informatique et l'écriture m'a mené relativement tôt (2000) au journalisme technique. Comment utiliser la technologie sans se faire soi-même utiliser m'intéresse. Dans mon temps libre, j'aime faire de la musique où je compense mon talent moyen avec une passion immense.

Des informations intéressantes sur le monde des produits, un aperçu des coulisses des fabricants et des portraits de personnalités intéressantes.

Tout afficher